Coalición para la Procedencia y Autenticidad de Contenido: Un Esfuerzo Conjunto

En un esfuerzo conjunto para abordar la creciente preocupación por laTemores de Influencia en Elecciones: Prevención ante ‘Deepfakes’

difusión de contenidos falsos, Google, Meta y OpenAI han anunciado recientemente medidas destinadas a facilitar la identificación de imágenes y archivos creados o retocados mediante inteligencia artificial (IA). Estas acciones se desarrollan en el contexto de la Coalición para la Procedencia y Autenticidad de Contenido (C2PA), una iniciativa que propone un certificado estándar y cuenta con la participación de diversas entidades, desde gigantes tecnológicos hasta medios de comunicación y fabricantes de cámaras.

El temor a la manipulación de información con fines desinformativos, especialmente en el marco de procesos electorales, ha llevado a estas empresas a tomar medidas anticipadas. Con inversiones significativas en la mejora de la capacidad de la inteligencia artificial generativa, buscan prevenir el uso indebido de esta tecnología en los comicios de 2024.

Variadas Iniciativas en Marcha: Desde Marcas Visibles hasta Metadatos

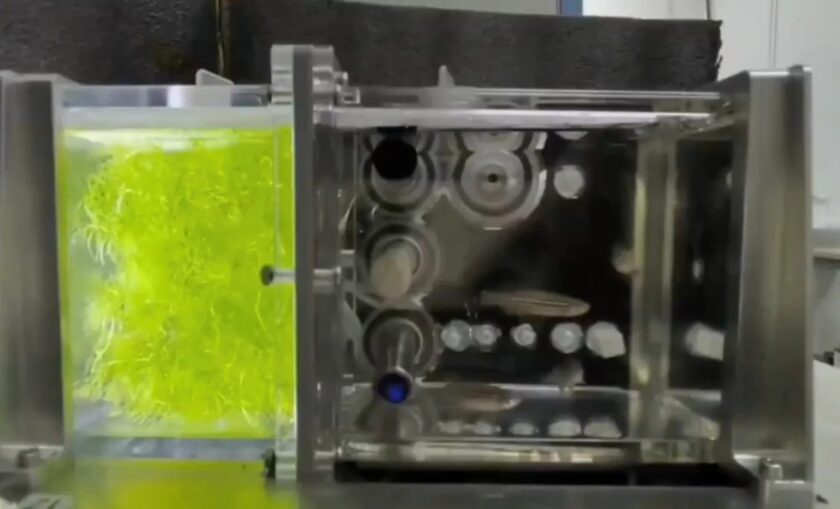

Las iniciativas presentadas varían desde la inclusión de marcas visibles en las propias imágenes hasta mensajes disimulados en los metadatos del archivo o en los píxeles generados artificialmente. Google, con su herramienta SynthID aún en fase beta, asegura haber encontrado una manera de identificar incluso audios generados por IA. Sin embargo, las empresas admiten que no existe, hasta el momento, una solución única y completamente eficaz para identificar todo el contenido generado con IA.

C2PA y sus Debilidades: Desafíos Técnicos en la Identificación

El estándar propuesto por C2PA para incluir información en los metadatos de la imagen ha sido objeto de críticas por sus debilidades técnicas. OpenAI, que utilizará C2PA en su generador de imágenes Dall-3, advierte sobre la necesidad de no depender exclusivamente de esta solución, señalando que “no es una solución milagrosa para abordar cuestiones de procedencia”.

Plazos Indefinidos: Necesidad de Protección Anticipada en Año Electoral

Aunque las compañías no han proporcionado plazos claros para la implementación completa de estas medidas, reconocen la vital necesidad de protegerse preventivamente, especialmente en un año electoral con múltiples citas importantes. La influencia potencial de contenido generado por IA en procesos electorales destaca la urgencia de abordar este problema.

Meta Comprometida con la Etiquetación y Detección Global en sus Plataformas

Meta, además de etiquetar visualmente las imágenes generadas por sus herramientas de IA, se compromete a detectar e identificar aquellas que se compartan en sus redes, incluyendo Instagram, Facebook y Threads. La empresa pretende abordar tanto el contenido generado por sus propias herramientas como el proveniente de otras fuentes.

Google y YouTube: Aplicación de Métodos Antidesinformación

Google tiene la intención de aplicar sus métodos antidesinformación a YouTube, buscando mantener la integridad de la información compartida en esta plataforma de videos. Aunque estas medidas representan avances técnicos, las empresas reconocen la constante evolución de las tácticas para eludir la detección, destacando la importancia de mantenerse a la vanguardia en la lucha contra la desinformación generada por IA.